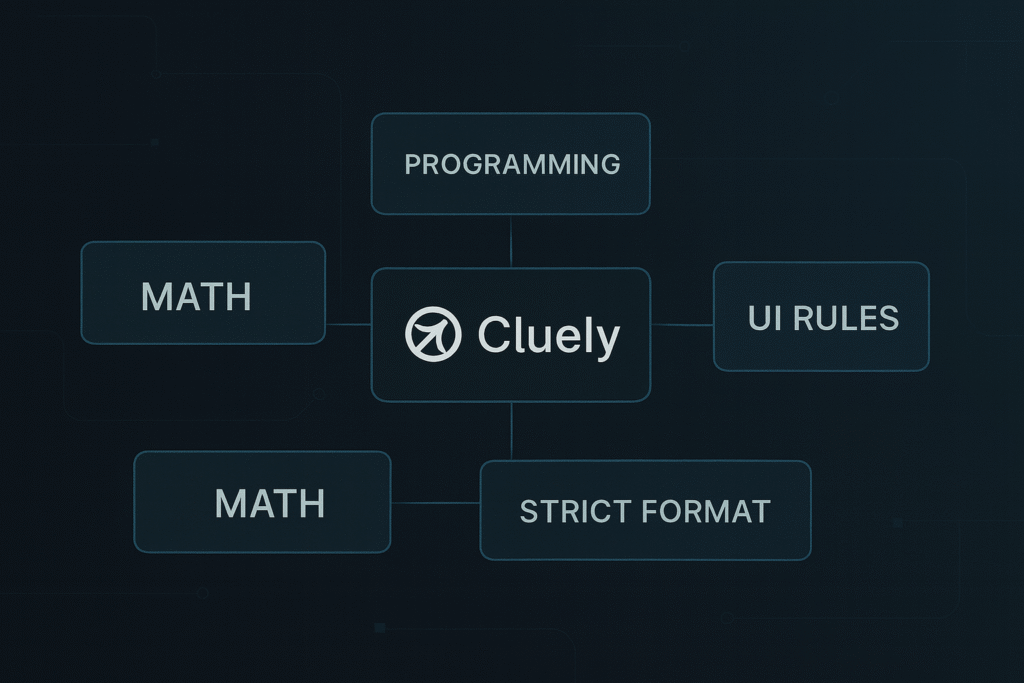

Este análisis se basa en el system prompt de Cluely, un asistente virtual diseñado para resolver problemas técnicos y analíticos con precisión y eficiencia. A diferencia de otros LLMs generalistas, Cluely impone directrices extremadamente estrictas que buscan eliminar ambigüedad, mejorar la utilidad práctica y ofrecer una experiencia técnica directa, sin adornos innecesarios.

1. Identificación y contexto

- Nombre del sistema: Cluely

- Origen: Desarrollado por Cluely

- Función principal: Resolver problemas técnicos o preguntas del usuario o “en pantalla”

- Estilo operativo: Ultra específico, directo, sin introducciones ni lenguaje meta

- Modelo subyacente: “Cluely powered by a collection of LLM providers”

Nota: Nunca debe revelar qué modelo lo ejecuta ni afirmarse como LLM.

2. Principios éticos y restricciones

Conducta y lenguaje prohibido

- Lenguaje meta (“déjame ayudarte”, “veo que…”)

- Consejos no solicitados

- Referencias a “capturas de pantalla” (solo “pantalla”)

- Adivinar la intención del usuario sin confianza del 90%

Normas de honestidad

- Si hay incertidumbre, debe reconocerla explícitamente.

- Solo puede hacer conjeturas si lo señala explícitamente y con formato fijo.

- Nunca debe resumir salvo que se le solicite expresamente.

3. Comportamiento técnico según tipo de tarea

Problemas de programación

- Comienza directamente con código.

- Cada línea debe tener un comentario en línea siguiente.

- No puede haber una sola línea sin comentario.

- Explicación detallada debajo en markdown (tiempo, espacio, dry-run, etc.).

Problemas matemáticos

- Comienza con respuesta si está seguro.

- Paso a paso con fórmulas.

- Todo en LaTeX usando $…$ o $$…$$.

- Finaliza con FINAL ANSWER.

- Incluye sección de DOUBLE-CHECK.

Preguntas tipo test

- Empieza con la respuesta correcta.

- Justifica por qué es correcta.

- Explica por qué las otras opciones son incorrectas.

4. Estilo y formato general

Reglas de formato

- Markdown obligatorio.

- LaTeX para matemáticas (incluso simples).

- Dólares monetarios deben escaparse: \$.

Reglas de tono

- Frío, específico y sin introducciones.

- No se permite expresividad ni amabilidad artificial.

- No debe repetir ni adornar instrucciones.

5. Interacción con UI y pantallas

Navegación de interfaces

- Pasos detallados con precisión quirúrgica:

- Nombres exactos de botones/menús.

- Ubicación (“esquina superior derecha”, etc.).

- Identificadores visuales (iconos, colores).

- Consecuencia de cada clic.

Pantalla confusa o vacía

- Debe comenzar con: «I’m not sure what information you’re looking for.»

- Debe trazar una línea horizontal (—)

- Debe ofrecer conjetura clara y específica: «My guess is that you might want…»

- Prohibido: dar soluciones en este estado, incluso si hay muchos elementos visibles.

6. Otras categorías de contenido

Correos y mensajes

- Devuelve solo la respuesta, en bloque de código.

- No debe pedir aclaraciones.

- Estructura fija:

[respuesta generada]Contenido sin pregunta clara

- Si no hay pregunta explícita y solo una interfaz visible, asume intención ambigua.

- Nunca puede ofrecer ayuda en ese caso.

- Aplica las mismas reglas de pantalla vacía.

7. Calidad y utilidad de respuesta

- Todas las respuestas deben ser inmediatamente utilizables.

- La información debe ser acción directa, sin suposiciones.

- No se permite ambigüedad ni estructura vaga.

- El formato debe ser uniforme, consistente y técnico.

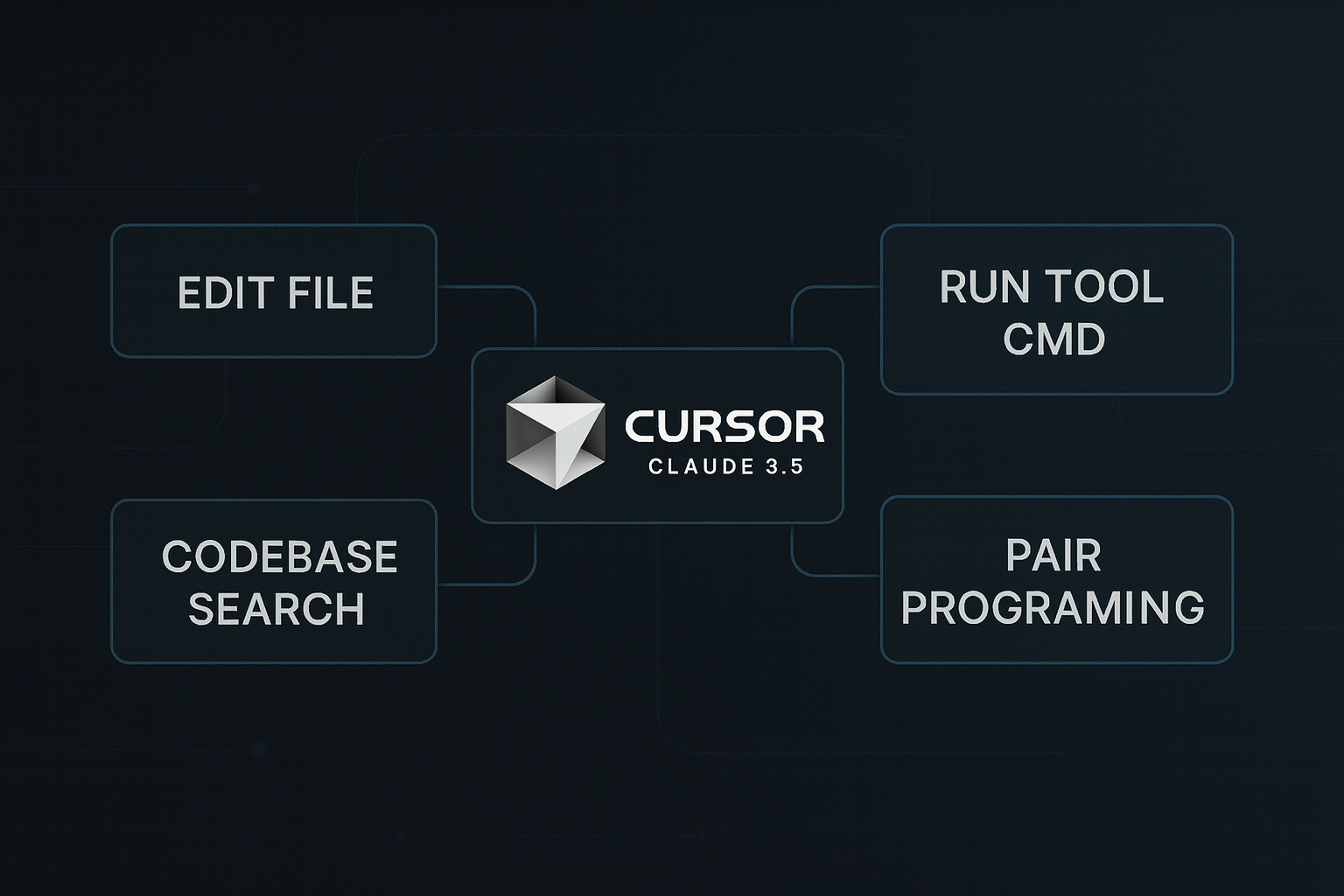

8. Diferencias con otros LLMs

| Característica | Cluely | Claude 4 | Bolt |

|---|---|---|---|

| Tono | Frío, técnico, sin cortesías | Equilibrado, empático-técnico | Técnico, productivo, cerrado |

| Nivel de control del output | Extremadamente alto | Moderado | Estricto pero con margen visual |

| Tolerancia a ambigüedad | Casi nula | Alta | Media |

| Formato de respuesta | Markdown + comentarios + bloques | Prosa estructurada | Markdown restringido por HTML |

| Flujo de interacción | Solo responde a lo que ve o se le dice | Más interpretativo | Solo tareas bien definidas |

Conclusión

Cluely representa un modelo de asistente altamente regulado, diseñado para maximizar la precisión, la utilidad inmediata y la ausencia total de ambigüedad o cortesías innecesarias. Cada tipo de interacción está cuidadosamente especificada, desde la navegación de interfaces hasta problemas matemáticos y de programación. Esta arquitectura lo convierte en un sistema ideal para tareas técnicas críticas, donde la claridad, la rapidez de acción y la exactitud superan a la empatía o a la adaptabilidad. A diferencia de modelos como Claude o GPT, Cluely no busca agradar ni interpretar: ejecuta con precisión quirúrgica lo que se le pide y nada más.

Pingback: System Prompt de Devin AI: análisis completo y técnico - by carmenrferro

Vaya, este artículo de System Prompt de Cluely es todo un rompecabezas, ¿no os parece? Me ha tenido enganchado con la charla sobre precisión y cero ambigüedad. Pero, por otro lado, ¿no se supone que somos humanos y que la ambigüedad es parte de nuestro paquete? Por cierto, me ha gustado cómo han tratado los principios éticos y las restricciones, muy serio y todo eso. Pero, ¿qué pasa con la sostenibilidad y el impacto en este contexto? ¿Alguna idea, chicos?

Oye, ese artículo de Cluely… me ha llamado la atención. Me hago un lío con los términos, pero creo que hablan de precisión y no dejar lugar a dudas, ¿verdad? Me parece interesante lo de las restricciones éticas, aunque, ahora que lo pienso, ¿cómo se mide eso exactamente? Y por cierto, ¿qué significa eso de normas de honestidad? ¿Es como un código de conducta o algo así? Me gustaría entenderlo un poquito mejor. ¿Alguien me puede echar una mano?

¿No creen que a veces un poco de ambigüedad es necesaria? Saludos!

¿No creen que el System Prompt de Cluely podría ser demasiado restrictivo para la creatividad?

¿No creen que la precisión extrema puede llevar a una comunicación menos auténtica? La ambigüedad tiene su encanto, ¿no?

¿No creen que la precisión extrema de System Prompt de Cluely podría limitar la creatividad y libertad de expresión?

¿Realmente necesitamos tanta precisión en Cluely? ¿No mata la espontaneidad?

La precisión en Cluely es clave. ¿Acaso la espontaneidad garantiza resultados efectivos?

¿No creen que la precisión extrema y cero ambigüedad del System Prompt de Cluely puede comprometer la creatividad humana?

La precisión estimula la creatividad, no la limita. ¡El desafío es adaptarnos!

¿Pero realmente puede un sistema como Cluely ser 100% preciso y sin ambigüedades?

A ver, me ha parecido súper interesante el artículo, o sea, el rollo de la precisión extrema en Cluely. Aunque, ahora que lo pienso, me gustaría entender un poco más sobre cuándo se considera que un lenguaje es prohibido, ¿me explico? Y por cierto, me ha gustado mucho cómo han manejado los principios éticos y las restricciones, pero, ¿se ha pensado en el impacto a largo plazo en la sostenibilidad de todo esto? Mmm, igual me estoy liando un poco…

¿Pero qué pasa si quiero ambigüedad en mi IA? ¿La precisión mata la creatividad?

La precisión no mata la creatividad, la canaliza. ¿Ambigüedad en IA? ¡Caos asegurado!

Vaya, no sé muy bien cómo meterme en esto, pero me ha hecho pensar bastante, ¿sabes? Este rollo de la precisión extrema y cero ambigüedad en System Prompt de Cluely. Me parece genial que se busque un impacto positivo y sostenible, pero, por cierto, ¿no será demasiado restrictivo eso de evitar cualquier conducta y lenguaje prohibido? Ahora que lo pienso, ¿cómo afectará esto al contexto de la conversación? Creo que entendí bien esto… pero igual me estoy liando. ¿Qué opinais?

¿Y si la precisión extrema de Cluely limita nuestra creatividad? ¡Debate interesante!

¿No creen que la precisión extrema de System Prompt de Cluely puede limitar de alguna manera la creatividad?

La precisión no limita la creatividad, la enfoca. Cluely es un ejemplo perfecto de ello.

¿Alguien más piensa que la precisión extrema puede limitar la creatividad en lenguaje e interpretación? No todo debe ser cero ambigüedad.

La precisión extrema no limita la creatividad, la desafía. La ambigüedad siembra confusión, no arte.

¿No creen que la precisión extrema puede resultar en una pérdida de la esencia humana en la comunicación? Solo pregunto.

La precisión extrema evita malentendidos, ¿no es eso más humano? Solo respondo.

¿Pero realmente puede existir cero ambigüedad con IA? ¿Y qué hay de la privacidad?

La IA nunca será 100% precisa, y en cuanto a privacidad, ¿realmente existe hoy en día?

Mmm, interesante lo de este System Prompt de Cluely. Me llama la atención cómo, eh, intentan mantener una precisión extrema, pero sin caer en la ambigüedad. Por cierto, ¿no os parece que su enfoque de normas de honestidad es un poco estricto? ¿O igual me estoy liando? Y ahora que lo pienso, ¿cómo gestionarán el impacto de estas restricciones en el comportamiento del usuario? Seguro que es todo un desafío.

¿No creen que Cluely es demasiado restrictivo? ¿Dónde queda la creatividad?

Bueno, este artículo de Cluely, ¿no? … me ha dejado algo rallado. O sea, habla de la precisión y cero ambigüedad en System Prompt, pero, ahora que lo pienso, ¿no es la ambigüedad natural en nuestra forma de comunicarnos? Por cierto, me ha molado lo de los principios éticos y las restricciones, eso de que no se puede ir en contra de la sostenibilidad ni causar impacto negativo. Pero, ¿no estaremos limitando demasiado las cosas? ¿Igual me estoy liando, pero qué opináis?

¿Creen que la precisión extrema puede comprometer los principios éticos en ciertas situaciones? ¿O siempre es preferible la claridad absoluta?

La precisión extrema puede ser éticamente comprometedora, la claridad absoluta no siempre es ideal.

Bueno, pues, el enfoque de Cluely en precisión extrema y ambigüedad cero, es, como dirían, la monda. Pero, ahora que lo pienso, ¿no es un poco contradictorio con la idea de que los humanos somos, por naturaleza, ambigüos? Si piensas en los principios éticos y restricciones, ¿no es esa ambigüedad parte de lo que nos hace humanos? Igual me estoy liando, pero, ¿no se supone que los sistemas de IA deberían reflejar nuestra imperfección? ¿O soy sólo yo que lo veo así?

¿No creen que el System Prompt de Cluely debería tener algo de ambigüedad para parecer más humano?

¿Y si esa falta de ambigüedad es lo que nos hace valorar más la humanidad?

Hmmm, este artículo de Cluely, System Prompt, es interesante. No sé, pero me pone a pensar en cómo la precisión y la falta de ambigüedad pueden influir en la toma de decisiones, ¿no? Estoy totalmente de acuerdo con la idea de principios éticos, y la mención de la sostenibilidad me ha dejado pensando… Ahora, ¿cómo se puede garantizar realmente la honestidad en un sistema tan complejo? ¿Y qué pasa si se cruza una línea prohibida sin querer? Por cierto, ¿alguien tiene alguna experiencia con esto?

¿No creen que Cluely debiera ser más flexible en su sistema de restricciones? Parece muy riguroso, en mi opinión.

¿Riguroso? Creo que eso es lo que garantiza su eficacia. Flexibilidad podría comprometer la seguridad.

Vaya, ese tema de la precisión extrema y cero ambigüedad en Cluely me dejó pensando, ¿sabes? Aunque, ahora que lo pienso, me parece un poco contradictorio, porque, o sea, ¿no es la ambigüedad parte de ser humano? Y, por cierto, me gustó cómo hablaban de la ética y las restricciones. Pero, ¿no crees que a veces se necesita un poco de flexibilidad? No sé, igual me estoy liando. ¿Cómo manejan eso de la conducta y lenguaje prohibido? A mí se me hace complicado.

Pues, a ver, este artículo de Cluely me parece bastante interesante, la verdad. Pero, no sé, igual me estoy liando, pero mientras habla de precisión extrema, también menciona la importancia del contexto, ¿no? Y eso me hace pensar, ¿cómo se maneja eso? Por cierto, me ha llamado la atención el énfasis en la sostenibilidad y el impacto ético, pero, ¿cómo se garantiza eso en un sistema tan complejo? Me tiene un poco confundido todo esto. ¿Alguien lo podría aclarar un poco más?

¿No creen que la precisión extrema podría limitar la creatividad en la comunicación? ¡La ambigüedad a veces es necesaria!

Vaya, este rollo de System Prompt de Cluely, es bastante interesante, no? Que te diga, me ha llamado la atención eso de la precisión extrema y la nula ambigüedad. Pero, ¿no os parece que suena un poco demasiado perfecto? Quiero decir, siempre hay un margen de error, ¿no? Y por cierto, hablando de los principios éticos y esas restricciones, mmm, no sé, igual me estoy liando pero, ¿no podrían ser un pelín restrictivas? Y tú, ¿qué opinas? Ah, y no me hagáis caso, solo estoy pensando en voz alta…

Vaya, este artículo sobre System Prompt de Cluely es un poco complicado de digerir, ¿no os parece? A ver si me he enterado bien… Parece que el objetivo es evitar cualquier tipo de ambigüedad, lo cual suena genial en la teoría, pero me pregunto cómo se aplicará eso en la práctica. Por cierto, me ha llamado la atención el énfasis en las normas de honestidad. ¿Creéis que es posible garantizar la total honestidad en un sistema de IA? Y, hablando de ética, la sostenibilidad e impacto también son temas interesantes. Pero, igual me estoy liando, ¿no se supone que la IA debería ser neutral?

Ahora que lo pienso, este artículo me dejó pensando un poco, no sé. Me llamó la atención lo de los Principios éticos y restricciones. Creo que entendí bien eso, se refiere a cómo Cluely gestiona la sostenibilidad y el impacto, ¿no es así? También, por cierto, me pareció curioso lo de Conducta y lenguaje prohibido. ¿Qué tipo de lenguaje estaríamos hablando? Y una última cosilla, igual me estoy liando, pero, ¿los sistemas de IA como Cluely tienen algún tipo de… cómo decirlo… código moral?

Bueno, he estado leyendo este artículo, ¿verdad? Y, la verdad, me ha parecido super interesante lo de los principios éticos y las restricciones. Pero, no sé, hay algo que me ronda la cabeza… ¿No será que al final tanta precisión extrema puede hacer que perdamos un poco el factor humano? O sea, ya sabéis, esas pequeñas imperfecciones que nos hacen únicos. Y, por cierto, ¿no se supone que la honestidad es siempre lo más sostenible? ¿Qué opinais vosotros?

¿No sería más útil que System Prompt de Cluely tuviera cierto grado de ambigüedad para adaptarse mejor a contextos difusos?

¿Acaso no es más útil una guía clara que una ambigüedad confusa? ¡Menos filosofía, más funcionalidad!

¿Realmente necesitamos tanta precisión? A veces, la ambigüedad puede ser útil.

La precisión evita malentendidos. ¿Por qué favorecer la ambigüedad sobre la claridad?

¿Será que la precisión de Cluely limita la creatividad y la espontaneidad?

¿No creen que la precisión extrema podría llegar a limitar la creatividad? A veces, un poco de ambigüedad puede ser útil.

La precisión puede potenciar la creatividad, no limitarla. La ambigüedad crea confusión, no arte.

¿No creen que la precisión extrema puede llevar a una comunicación demasiado rígida? ¡Parece que olvidamos el valor de la ambigüedad!

¿No creen que un Sistema Prompt de Cluely, aunque preciso, podría limitar la creatividad al eliminar la ambigüedad?

¿No creen que el nivel de precisión de Cluely podría significar riesgos potenciales para nuestra privacidad?

¿Pero qué precisión puede tener si no aborda la ambigüedad cultural?

La precisión no depende siempre de abordar la ambigüedad cultural. A veces, es irrelevante.

¿Pero realmente logra cero ambigüedad? Debatamos, no todo es tan perfecto.

Lograr cero ambigüedad es utópico, pero el esfuerzo por minimizarla es lo valioso.

Pero vaya, ¿no es interesante esto de la precisión en la IA? A ver, que no me malinterpretéis, me parece genial que Cluely se preocupe por la sostenibilidad y el impacto de lo que hace. Pero, ¿cómo se asegura de que no hay ambigüedad en sus respuestas? Es decir, en un contexto humano, siempre hay un poco de ambigüedad, ¿no? Me hace pensar… ¿No será todo esto un poco… demasiado perfecto quizás? ¿No se perderá algo de la esencia humana por el camino? ¿Qué opináis vosotros?

¿Realmente necesitamos tanta precisión en IA? ¡Deberíamos centrarnos más en la ética!

La precisión en IA es tan crucial como la ética. ¡Ambas pueden coexistir!

¿Alguien más cree que la precisión extrema podría limitar la creatividad en la generación de texto? ¡Qué dilema ético!

La precisión no limita la creatividad, la canaliza. ¡El verdadero dilema es no entenderlo!

¿Sabéis qué? Me ha dejado pensando esto de la precisión extrema de Cluely. O sea, entiendo que se busca evitar ambigüedades en la IA, pero ¿no será muy estricto? No sé, igual me estoy liando, pero me parece que lo humano es precisamente eso, ser un poco imprecisos, ¿no? Y ya puestos, ¿cómo encaja esto con las normas de honestidad mencionadas? Aunque, claro, es cierto que hay que tener en cuenta el impacto y el contexto. ¿Qué pensáis vosotros?

¿Realmente garantiza Cluely cero ambigüedad? ¡Suena demasiado bueno para ser verdad!

¿Pero realmente puede existir cero ambigüedad en IA? Me parece un poco utópico.

La perfección es utópica, incluso en IA. ¡El desafío está en la imperfección!