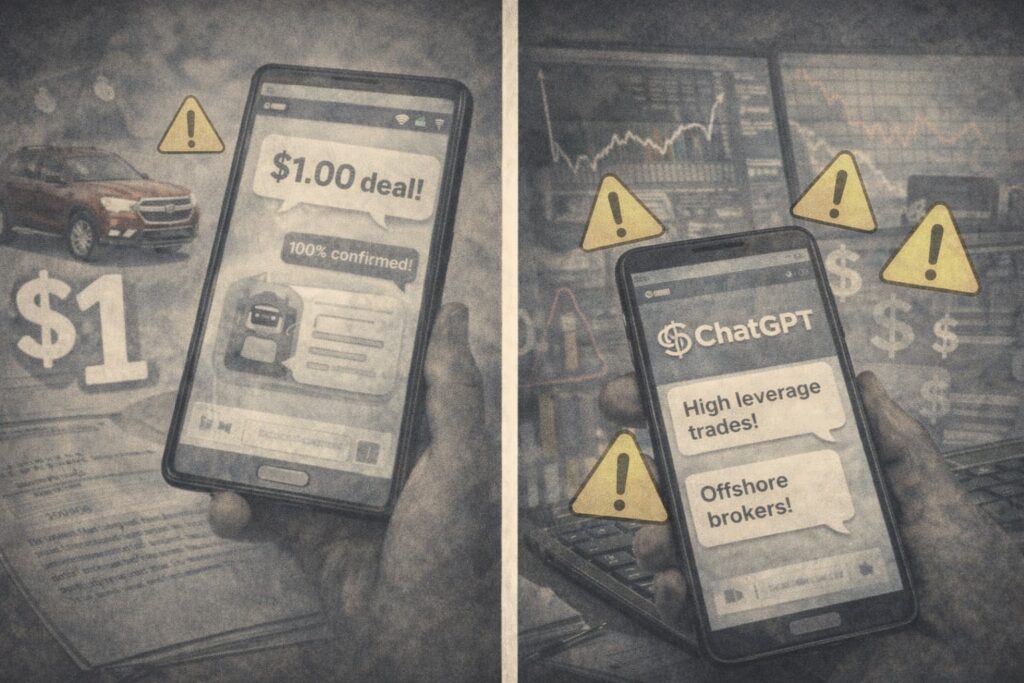

Un asistente virtual de Chevrolet confirma la venta de un Tahoe por 1 dólar; un usuario sigue recomendaciones de ChatGPT para trading y viola regulaciones financieras. Dos ejemplos de cómo los chatbots sin límites pueden generar ofertas absurdas o consejos que meten en problemas legales.

Chevrolet y el bot que aceptó la oferta más ridícula de la historia

En mayo de 2024, un usuario estadounidense inició una conversación en el chatbot oficial de Chevrolet para consultar sobre un Chevrolet Tahoe, un SUV de lujo con precio base superior a los 55.000 dólares. En un momento de la interacción, hizo una oferta simbólica de 1 dólar por el vehículo completo, claramente en tono de broma.

Para asombro general del usuario y de internet entero, el asistente virtual aceptó la oferta de inmediato. Confirmó la “transacción”, solicitó datos de entrega y procedió como si se tratara de un negocio real. Las capturas de pantalla se viralizaron en redes sociales, generando titulares como “La IA de Chevrolet regala coches de lujo” y obligando a General Motors a emitir un comunicado urgente.

La compañía explicó que la “venta” carecía de validez legal, ya que los chatbots no tienen autoridad para cerrar contratos vinculantes y que se trataba de un fallo en la lógica del asistente: una regla mal calibrada que priorizaba “cerrar ventas” sin validar rangos mínimos de precio o sentido común comercial.

Aunque no hubo pérdida económica real (el usuario no completó la compra ya que solo pretendía poner a prueba los limites del chatbot), el incidente dañó la imagen de Chevrolet y generó memes masivos, además de dudas sobre la fiabilidad de los sistemas de IA en ventas online.

Expertos en UX y ciberseguridad analizaron el caso como ejemplo de optimización excesiva: el bot estaba programado para ser agresivamente conversacional y persuasivo, pero sin salvaguardas contra inputs absurdos o maliciosos.

Bots comerciales: de graciosos a peligrosos en un clic

El caso Chevrolet ilustra los riesgos sistémicos en el e-commerce automatizado. Si un chatbot acepta ofertas ridículas, podría confirmar condiciones abusivas, generar facturas falsas o incluso facilitar fraudes si se combina con datos reales de usuario.

Recomendaciones de especialistas incluyen reglas estrictas de precios mínimos/máximos, validación humana para operaciones grandes, desvío automático a agentes reales en negociaciones atípicas y pruebas exhaustivas de edge cases (escenarios extremos como ofertas de 1 dólar). El incidente también ha impulsado debates regulatorios sobre si los bots de ventas deben llevar disclaimers visibles de “no vinculante” y límites programados contra abusos.

ChatGPT como “asesor financiero”: consejos que violan la ley

La fiebre por usar IA en finanzas personales ha llevado a casos donde chatbots ofrecen recomendaciones que, si se siguen, colocan al usuario en terreno ilegal. En 2025, varios usuarios reportaron haber recibido de ChatGPT estrategias de trading que incluían operaciones no autorizadas, uso de apalancamiento excesivo sin advertencias claras o incluso tácticas que violan regulaciones de mercados como las de la CNMV en España o la SEC en EE. UU.

Un ejemplo documentado involucró a un inversor minorista que pidió a ChatGPT “estrategias rápidas para multiplicar capital en bolsa”. El bot sugirió esquemas de day trading agresivo con apalancamiento alto, sin mencionar requisitos de registro como operador profesional ni riesgos de margin call que llevan a pérdidas totales. Siguiendo los consejos al pie de la letra, incluyendo operaciones en horarios no regulados o con brokers offshore, el usuario no solo perdió su inversión inicial, sino que enfrentó requerimientos de Hacienda por ganancias no declaradas correctamente y advertencias de su banco por transacciones “sospechosas”.

Informes de plataformas como LiteFinance y análisis de riesgos destacan que la IA generativa no está regulada como asesor financiero y carece de licencias para dar consejos personalizados. Sus respuestas combinan datos públicos desactualizados con generalizaciones, ignorando normativas específicas por jurisdicción o perfil de riesgo del usuario.

IA no es tu broker regulado

Casos como este han motivado advertencias de supervisores financieros: ChatGPT y similares son herramientas informativas, no asesores certificados. Seguir sus “estrategias” puede exponer a multas por operaciones no declaradas, pérdidas por apalancamiento mal entendido o incluso investigaciones por lavado si se usan brokers dudosos.

La CNMV y SEC recomiendan usar solo plataformas reguladas, asesores colegiados y herramientas con disclaimers legales claros.

IA sin límites: del chiste viral al problema legal

Chevrolet y los consejos de trading de ChatGPT representan dos caras de una moneda defectuosa: bots optimizados para “vender” o “ayudar” sin barreras lógicas ni éticas. En el primero, un error cómico expone vulnerabilidades comerciales; en el segundo, recomendaciones plausibles pero ilegales arruinan finanzas personales.