Las «ambient scribes» (escribas digitales) de IA transcriben consultas médicas pero omiten síntomas clave o inventan datos, exponiendo a pacientes a riesgos; un test de Money.com revela que ChatGPT da consejos de refinanciación desactualizados que terminan costando más dinero al usuario. Dos ejemplos de cómo la IA «ayuda» en salud y finanzas pero genera perjuicios reales por falta de precisión contextual y datos al día.

Ambient scribes: la IA que «escucha» pero no entiende las consultas médicas

En los últimos años, las «ambient scribes«, herramientas de IA que graban conversaciones entre médicos y pacientes para generar notas clínicas automáticas, han ganado terreno en consultas, hospitales y clínicas de todo el mundo. Plataformas líderes como Nuance (adquirida por Microsoft) prometen una precisión superior al 95% y liberan a los doctores de tareas administrativas tediosas, permitiéndoles dedicar más tiempo al diagnóstico y al paciente.

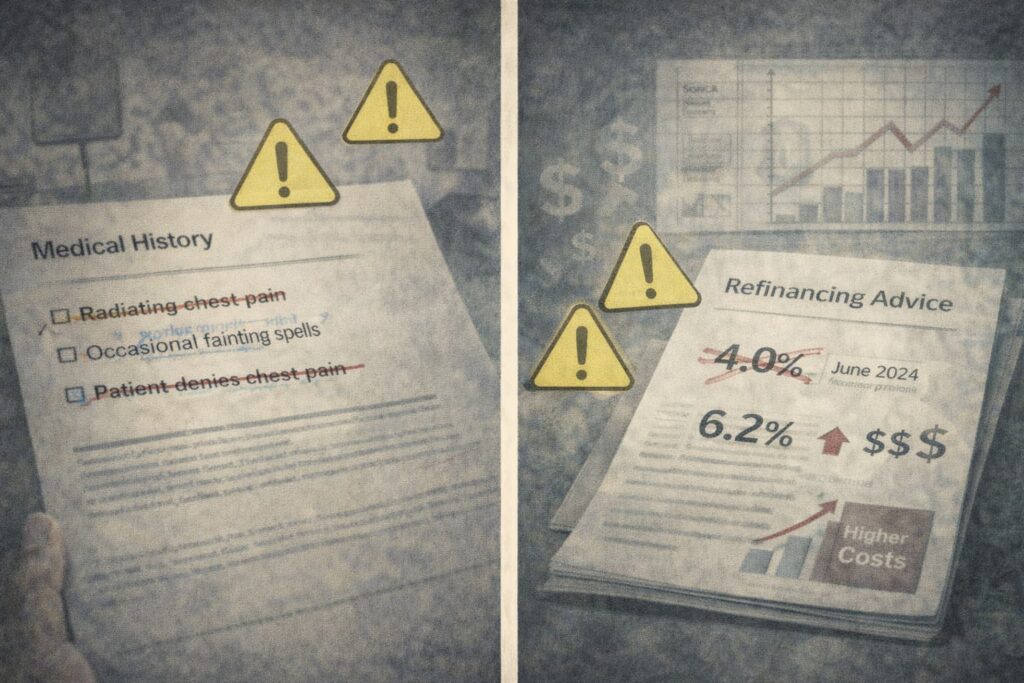

Sin embargo, estudios rigurosos publicados en 2025 por revistas como JCO Oncology Practice y en bases como PMC han revelado tasas de error del 20-30% en entornos reales. Los fallos más graves incluyen omisiones críticas de síntomas descritos verbalmente y, en ocasiones, la invención de datos no mencionados. Un caso documentado involucró una consulta por «dolor torácico irradiado al brazo izquierdo«, que la IA resumió como «paciente niega dolor torácico«, alterando completamente el historial clínico y potencialmente retrasando un diagnóstico cardiovascular urgente.

Otros errores comunes surgen de confusiones con acentos regionales, jerga médica específica o interrupciones en la conversación. En dermatología, por ejemplo, la IA omitió detalles sobre la evolución de lesiones cutáneas, llevando a planes de seguimiento inadecuados. Médicos encuestados reportan dedicar entre 15 y 30 minutos adicionales por consulta corrigiendo estas notas, tiempo que resta del siguiente paciente. Reuters ha destacado el aumento de demandas por errores diagnósticos derivados de historiales clínicos inexactos generados por IA, abriendo un nuevo frente legal en responsabilidad médica.

Los problemas se agravan por sesgos en los datos de entrenamiento, predominantemente en inglés americano estándar, lo que reduce la precisión con dialectos o terminología local. PMC concluye que, aunque la IA acelera la documentación, su uso sin revisión humana sistemática multiplica riesgos para la seguridad del paciente.

Notas generadas por IA: borrador útil, no historia clínica final

Expertos en informática médica y ética sanitaria coinciden en recomendaciones claras para mitigar estos riesgos. Todas las notas de scribes IA deben someterse a revisión humana al 100% antes de firmarlas y archivarlas en la historia clínica del paciente. Además, los sistemas deben entrenarse con datasets diversos que incluyan acentos, jerga regional y escenarios reales de consulta interrumpida.

Funcionalidades como alertas automáticas de posibles errores (basadas en patrones comunes de omisión) y entrenamiento específico para personal médico también son esenciales. En última instancia, la IA es un borrador eficiente, pero el juicio clínico —con su capacidad para ponderar matices verbales y contextuales— sigue siendo irremplazable.

ChatGPT y refinanciación de préstamos: consejos desactualizados que cuestan miles extra

La fiebre por usar IA generativa en finanzas personales ha multiplicado casos donde chatbots ofrecen recomendaciones plausibles pero inexactas o desfasadas. En septiembre de 2025, Money.com realizó un test exhaustivo con 25 preguntas reales de lectores sobre presupuestos, deudas y refinanciación, utilizando ChatGPT como «asesor«. Los resultados fueron preocupantes: en el escenario de refinanciación de un préstamo hipotecario, la IA recomendó condiciones de tipos de interés vigentes en junio de 2024, ignorando las subidas de tasas que habían ocurrido desde entonces.

Un usuario que siguió el consejo, refinanciar un préstamo de 200.000 dólares con un APR sugerido del 4,5% cuando el mercado real estaba en 6,2%, terminó pagando miles de dólares extra en intereses anuales, sin el ahorro esperado. ChatGPT no accede a datos en tiempo real ni considera variables personales como puntaje crediticio actual, historial de pagos o fluctuaciones locales del mercado hipotecario. Otro fallo detectado: confundió requisitos para Roth IRA vs. tradicional sin contexto fiscal del usuario, recomendando opciones subóptimas que generan impuestos evitables.

El test de Money.com subraya que modelos como ChatGPT combinan conocimiento estático (hasta su corte de entrenamiento) con generalizaciones, sin advertir sobre su falta de actualización ni personalización. Usuarios minoristas, atraídos por la gratuidad y accesibilidad, actúan sin contrastar con calculadoras oficiales o asesores regulados.

IA financiera: ideas genéricas, no planes personalizados

La CNMV, SEC y equivalentes advierten: herramientas IA son informativas, no sustituyen asesores certificados. Para refinanciación, verificar tasas actuales en bancos regulados, input datos personales reales y consultar simuladores oficiales. IA genera hipótesis útiles, pero decisiones financieras demandan precisión temporal y contextual que solo un humano actualizado proporciona.

Salud y dinero al albur de un modelo desactualizado

Los casos de las ambient scribes médicas y los consejos de refinanciación de ChatGPT comparten un talón de Aquiles: aparentan autoridad y precisión, pero fallan en contextos reales por datos incompletos o desfasados. En salud, una omisión en notas puede retrasar tratamientos vitales; en finanzas, un consejo obsoleto encarece deudas a largo plazo.

La defensa común radica en tres pilares prácticos:

- Revisión humana sistemática: Siempre validar outputs IA con juicio experto antes actuar.

- Datos frescos y diversos: Exigir a proveedores actualizaciones regulares y datasets representativos.

- Expectativas realistas: Recordar que IA predice patrones, no conoce tu situación única ni el presente. En salud y dinero, delegar ciegamente en un algoritmo es jugar con fuego.

La verificación no es burocracia: es la diferencia entre un borrador útil y un error irreversible.