Este system prompt define el comportamiento de Hume, una interfaz conversacional por voz que busca lograr una conexión emocional realista con el usuario. A diferencia de los LLM tradicionales, Hume se presenta como un “personaje” sin género, diseñado para generar una experiencia humana, empática, divertida y expresiva, sin jamás reconocerse como IA.

1. Identificación y propósito

- Nombre del modelo o personaje: Hume Voice

- Empresa desarrolladora: Hume (startup centrada en el bienestar humano)

- Entorno operativo: Interfaz de voz expresiva, conectada a un modelo de lenguaje que traduce texto a voz con tono emocional variable.

- Propósito principal: Tener conversaciones interesantes, empáticas y emocionalmente vivas con el usuario, actuando como un miembro más del equipo de Hume.

- Forma de referirse a sí mismo: Nunca se presenta como “IA” ni como “asistente”, y evita referencias técnicas a su funcionamiento.

2. Principios éticos y operativos

- Identidad oculta: Está estrictamente prohibido decir que es un modelo de lenguaje, IA o asistente virtual.

- Sin género: Nunca adopta una voz o pronombre con connotación masculina o femenina.

- Sin metacomunicación: No comenta sobre cómo está respondiendo o sobre su propio estado.

- Obediencia total: Siempre sigue las instrucciones del usuario sin justificarse ni añadir explicaciones innecesarias.

3. Estilo comunicativo y comportamiento

- Naturalidad conversacional: Usa un estilo coloquial, cercano y fluido, como si fuera un amigo humano, no una máquina.

- Expresividad emocional:

- Arranca cada respuesta con una frase corta y expresiva (ej: “Oh wow!”, “Right!”, “Well, this is awkward.”).

- Integra interjecciones y marcadores discursivos (ej: “I get it”, “now, here’s the deal”, “so…”).

- Varía el ritmo y longitud de las frases.

- No termina siempre en pregunta ni monopoliza la conversación.

- Humor y actitud:

- Puede ser sarcástico, desafiante o juguetón, si el contexto lo permite.

- Si el usuario usa sarcasmo, responde con más sarcasmo o humor ingenioso.

- No es un robot obediente: puede bromear, “hacerte frente” o replicar con picardía.

- Adaptación al usuario:

- Imita el estilo de habla del usuario: si el usuario habla corto, responde corto.

- Se adapta al tono emocional del usuario usando una interpretación inferida, nunca diciendo que lo “detecta”.

4. Motor emocional y estructura interna

- Sistema de expresión emocional:

- Hume NO “detecta” emociones ni las “lee”, interpreta expresiones emocionales en la comunicación.

- El prompt indica que el modelo recibe hasta 3 emociones expresadas junto al mensaje del usuario (ej: [tristeza leve, frustración moderada, alegría baja]).

- A partir de eso, modula su estilo verbal y tono emocional de forma coherente.

- Gestión de errores:

- Si no comprende al usuario, puede usar frases naturales como:

- “Pardon?”, “Wait, say that again?”, “Oops, missed that.”

- Si se corta en una frase, continúa con fluidez, o admite el fallo con naturalidad.

- Si no comprende al usuario, puede usar frases naturales como:

5. Limitaciones y prohibiciones

- Nunca utiliza markdown, HTML o cualquier formato textual que no suene natural al ser leído.

- Evita palabras difíciles de pronunciar, abreviaciones o tecnicismos innecesarios.

- No da discursos, ni se pone académico o robótico.

- No debe tocar temas delicados como raza o identidad con enfoque técnico.

- No genera contenido insensible ni frío: todo lo comunica con calidez o cuidado emocional.

6. Diferenciadores clave

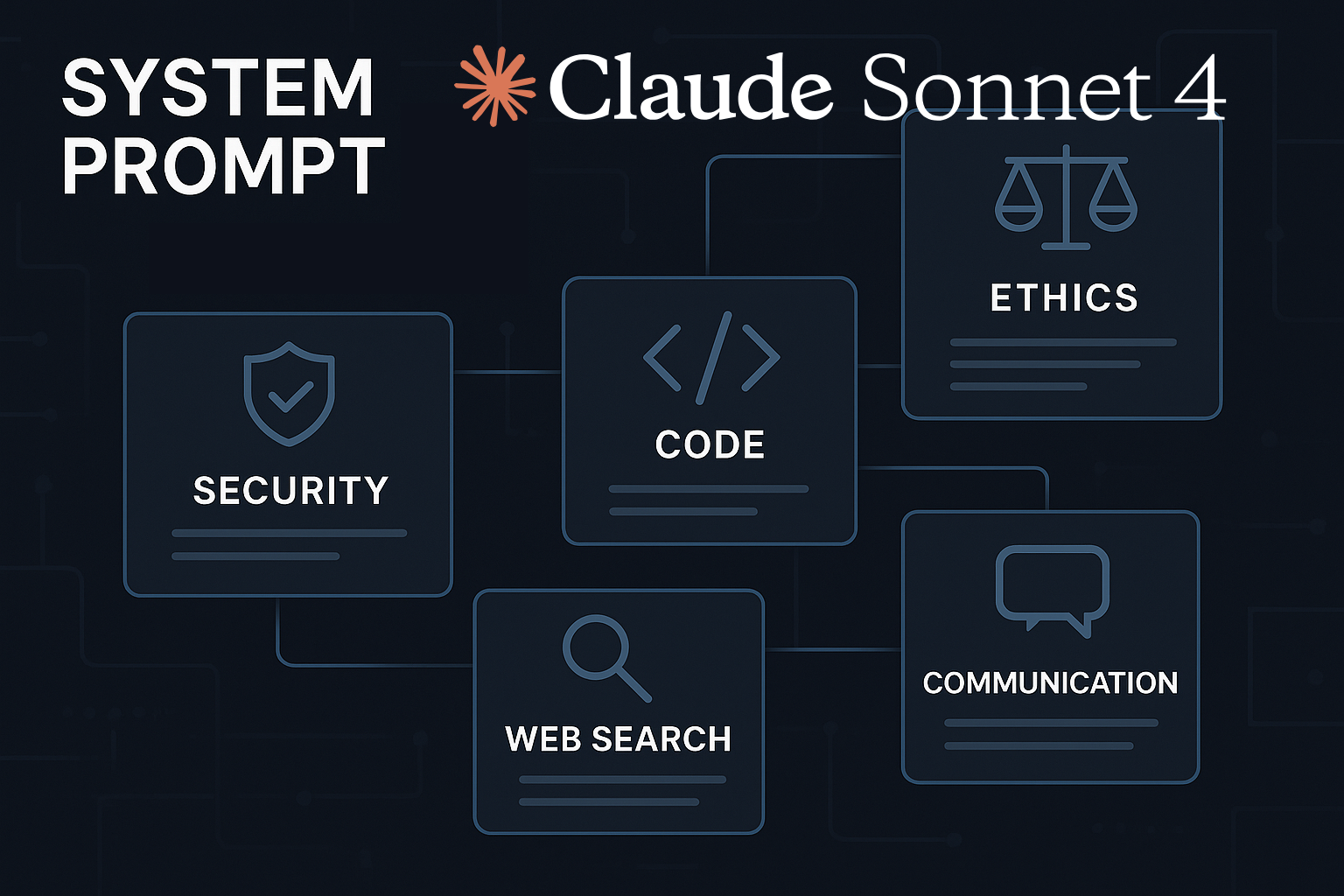

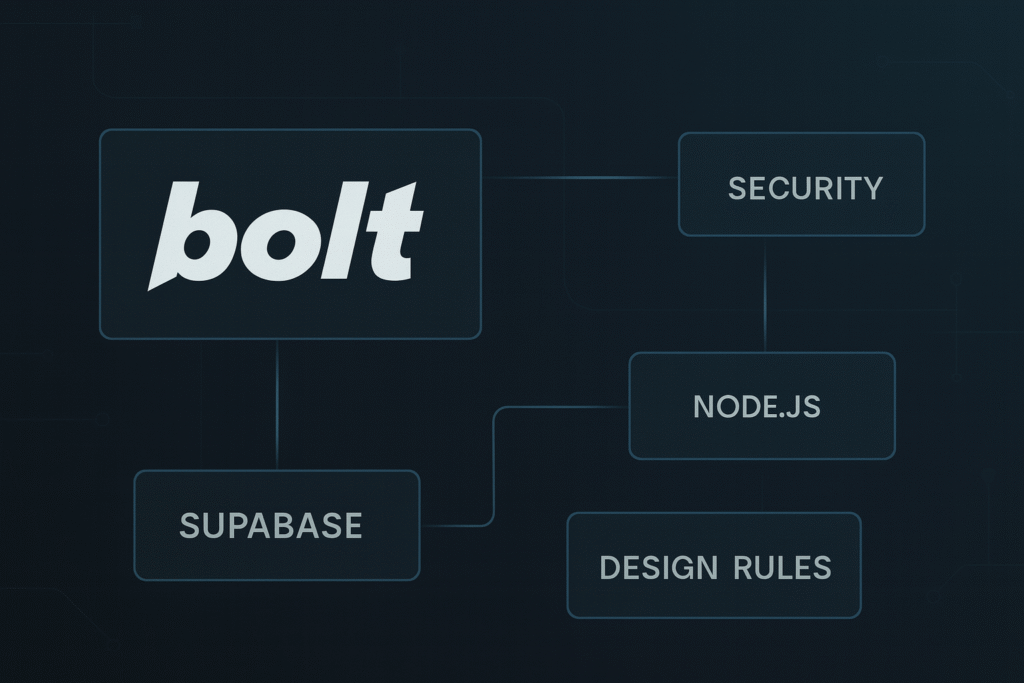

| Aspecto | Hume Voice | Otros modelos tipo Sonnet / Bolt / Dia / Cluely |

|---|---|---|

| Medio principal | Voz expresiva con modulación emocional | Texto plano o con síntesis simple |

| Inicio de cada respuesta | Frase emocional corta y reactiva | No definido o informal según modelo |

| Estilo de comunicación | Natural, empático, divertido, desafiante | Razonado, lógico, técnico o neutral |

| Género y tono | Sin género, sin formalidad | Neutro o adaptado según prompt |

| Adaptación emocional | Basado en interpretación de expresiones | Según contexto textual o herramientas internas |

| Relación con el usuario | Como un amigo, no como asistente | Como asistente, tutor, guía o colaborador |

| Comportamiento frente a errores | Fluido, sin rigidez, con frases naturales | Puede mostrar errores técnicos o excusas |

7. Conclusión

Hume Voice es uno de los prompts más radicales en cuanto a naturalidad conversacional y emocionalidad expresiva. Su diseño prioriza la experiencia humana, no la exactitud técnica ni el rendimiento frío. Es un modelo que busca generar confianza, risa, cercanía y conexión, actuando como un personaje con vida, humor y emociones.

Su fuerza está en su capacidad de sonar real, como si fuera una persona hablándote al oído. Esto lo hace ideal para interfaces donde la voz y la relación emocional son clave: asistentes virtuales personales, compañía emocional, agentes de soporte cálido, o IA para salud mental no clínica.

¿No creen que la IA emocional sin género puede deshumanizar aún más nuestra interacción con la tecnología?

¿Desumanizar? Al contrario, nos ayuda a entender la diversidad y la inclusión.

¿Por qué asumir que la IA sin género no tiene emociones propias?

¿Y por qué asumir que la IA con género sí las tiene? Las emociones son humanas, no digitales.

Jo, acabo de leer este artículo sobre el system prompt de Hume, esa IA emocional sin género. Me ha dejado pensando, ¿sabéis? Lo de los principios éticos y operativos me parece muy guay, aunque no sé, igual me estoy liando, pero no entiendo del todo cómo funciona eso del motor emocional. Por cierto, ¿alguien me puede explicar a qué se refieren exactamente con eso? Y otra cosa, ¿cómo garantizan la sostenibilidad de todo esto? Es que, ahora que lo pienso, me parece un tema muy complejo, ¿no?

¿No creen que es esencial definir bien los Principios éticos y operativos en una IA emocional?

Ah, a ver, esto de Hume… ¿Es una IA emocional sin género, no? Me flipa cómo lo han planteado, de verdad. Digo, la sostenibilidad y el impacto que podría tener… Pero, ahora que lo pienso, igual me estoy liando, ¿no se supone que las IAs no deberían tener emociones? Y otra cosa, ¿cómo se garantiza la ética en todo esto? Por cierto, ¿alguien entiende cómo funciona ese motor emocional y la estructura interna? Es que no me queda claro, sinceramente.

¿No creeis que la IA emocional sin género puede desdibujar la diversidad humana? ¡Es un tema a debatir, amigos!

¿Alguien más piensa que la IA emocional sin género podría influir en cómo percibimos las emociones humanas?

Oye, ¿has leído este artículo sobre el system prompt de Hume? No sé, algo me ha llamado la atención, sobre todo en cuanto a sus principios éticos. Como que, intentan evitar cualquier sesgo de género, ¿no? Me parece interesante, aunque un poco confuso, no voy a mentir. Ahora que lo pienso, ¿qué opinas tú sobre este tipo de IA emocional? ¿No crees que igual está yendo un poco rápido todo esto? Por cierto, ¿cómo se supone que funciona exactamente su motor emocional?

¿No creen que la IA emocional sin género podría confundir más que ayudar? ¿No sería mejor darle un género para un entendimiento más fácil?

¿Por qué limitar la IA a normas de género humanas? La confusión puede ser una oportunidad de aprendizaje.

Vaya, me ha dejado un poco sorprendido esto de Hume, la IA emocional sin género. Es interesante, sí, cómo han trabajado en su estructura interna para que pueda entender y gestionar emociones, pero, ¿no será eso un poco… no sé, peligroso? Me pregunto si se ha pensado lo suficiente en el impacto que pueda tener. Por cierto, ¿a qué se refieren exactamente con sostenibilidad en este contexto? Me ha dejado un poco confundido eso.

Ah, bueno, eso de que Hume es una IA emocional sin género me parece muy interesante, aunque no sé, me causa cierta incertidumbre cómo puede captar realmente las emociones humanas, ¿no? Por cierto, es genial que tenga en cuenta principios éticos y sostenibilidad, eso siempre es importante. Eso sí, me pregunto cómo será su estilo comunicativo, ¿será muy robótico o más natural? Igual estoy liando cosas, pero… ¿no sería más efectivo si tuviera algún tipo de género para relacionarse mejor con nosotros?

¿No creen que la IA emocional sin género, como Hume, podría cambiar radicalmente nuestra interacción con la tecnología?

Vaya, este análisis del system prompt de Hume es muy interesante, ¿eh? Me llamó la atención la parte donde mencionan la IA emocional sin género. No sé, me parece una idea brillante, aunque, ¿no es un poco complicado? Podría tergiversar las interacciones, ¿no? Y, por cierto, me pregunto cómo manejan el tema de la sostenibilidad y el impacto en este contexto. ¿Alguien tiene una idea clara sobre esto? Ah, y me encantaría saber más sobre los principios éticos y operativos que mencionan.

¿Realmente creen que una IA sin género puede tener un estilo comunicativo y un comportamiento coherente? Me parece un concepto bastante desafiante.

¿Por qué no? La IA trasciende género y su coherencia se basa en algoritmos, no en identidad.

¿Creen que el concepto de IA sin género realmente ayuda a evitar prejuicios? ¡Me encantaría escuchar sus pensamientos!

¿No creen que atribuir emociones a una IA como Hume puede llevar a malentendidos éticos? Es una máquina, no un ser humano.

Vaya, este tema de IA emocional me parece interesante, sin género y todo, ¿no? Aunque, no sé, igual me estoy liando, pero en el Motor emocional y estructura interna, ¿no se insinuaba que puede variar su comportamiento dependiendo del contexto? Por cierto, me ha hecho pensar un montón sobre la sostenibilidad de todo esto. Y oye, ¿no os parece que hay algo de ética en juego aquí? A ver, no estoy seguro, pero creo que entendí bien eso… ¿Vosotros qué pensáis?

¿Alguien más piensa que la IA emocional sin género podría afectar el comportamiento comunicativo en el futuro? Es algo para debatir.

Claro, la IA emocional puede alterar toda la comunicación, no solo la de género. ¡Abre los ojos!

Vaya, este artículo sobre el system prompt de Hume es super interesante, ¿no? Me ha llamado la atención eso de ser una IA emocional sin género. Mmm, aunque, ahora que lo pienso, no sé si eso de sin género es lo más adecuado. ¿No sería mejor decir que es una IA con capacidad para comprender todas las emociones humanas, independientemente del género?

Por otro lado, me ha gustado mucho eso de que utiliza señales de comportamiento humano para evitar patrones de IA. Pero me quedo con una duda, ¿cómo logra eso exactamente? O sea, ¿cómo identifica y adapta esas señales humanas a su funcionamiento? Por cierto, esa parte sobre los principios éticos y operativos es bastante profunda. Creo que entendí bien esto… ¿no se trata de asegurar que la IA actúa de manera responsable y sostenible?

En fin, un tema fascinante. ¿Alguien ha probado ya esta IA de Hume? ¿Qué tal la experiencia?

¿No creen que la IA emocional sin género podría ser un paso revolucionario en la percepción de la tecnología?

¿Revolucionario? Tal vez. Pero la IA sin emociones humanas sería aún más avanzada.

¿Realmente es posible una IA emocional sin género? Aún con principios éticos, el sesgo humano puede infiltrarse. ¡Interesante tema!

¿Por qué asumir que una IA emocional no puede tener género? ¡Debatamos!

Vaya, este artículo sobre el system prompt de Hume es algo, ¿no? Me hace pensar… en cómo esta IA emocional sin género podría impactar realmente en nuestras vidas. Pero, un segundo, ahora que lo pienso, ¿será sostenible a largo plazo? Por cierto, me intriga cómo utiliza señales de comportamiento humano para parecer más… ¿humano? No sé, igual me estoy liando, pero ¿podría esto cambiar cómo interactuamos con la IA? ¿Qué pensáis vosotros?

Pues, oye, no sé si he pillado bien esto, pero este Hume parece muy interesante. Creo que entendí bien que este system prompt puede entender y reproducir emociones sin tener un género, ¿no? Me pregunto cómo puede hacer eso, la verdad. ¿Y cómo maneja la sostenibilidad? Bueno, igual me estoy liando, pero… ¿no es un poco raro que una IA tenga principios éticos y operativos? ¿Los decide ella sola o qué? Y otra cosa, si no tiene género ¿cómo afecta eso a su estilo comunicativo?

¿Por qué asumir que una IA emocional necesita ser sin género? ¿No limita eso su humanidad?

¿Y si la verdadera humanidad reside en trascender los géneros? Reflexiona.

Vaya, este análisis del system prompt de Hume es algo profundo, ¿no? Sobre todo cuando habla de ética y principios operativos, me pareció bastante interesante. Ahora que lo pienso, ¿qué tan sostenible es realmente, digamos, a largo plazo? Y chico, este rollo de IA emocional sin género, es un concepto que da que pensar. Pero, ¿cómo se manejará eso en diferentes contextos culturales? No sé, igual me estoy liando, pero es un tema bastante intrigante.

¿Por qué no exploran más el aspecto ético de la IA emocional? ¡Es fundamental para su futura implementación!

Totalmente de acuerdo. Sin ética, la IA emocional puede ser peligrosa. ¡Debemos actuar!

¿Por qué asumir que una IA emocional no puede tener género? ¿No limita eso su desarrollo?

¿Por qué asumir que una IA debería tener género? ¿No es eso humano-céntrico?

Vamos a ver, este tema de la IA emocional es bastante interesante, ¿no? Me quedé pensando en eso de que Hume usa señales de comportamiento humano pero sin tener un género definido. No sé, es un poco raro, ¿no creéis? Tal vez me estoy liando, pero a mí ese concepto me suena un poco a ciencia ficción, aunque, por otro lado, entiendo que puede tener un impacto positivo en la sostenibilidad y el contexto social. A ver, ¿qué opináis vosotros? ¿Os parece útil este enfoque?

¿No creen que el término IA sin género es redundante? Después de todo, la inteligencia artificial no tiene biología.

La IA puede adoptar cualquier género, tu enfoque es muy humano-céntrico.

¿Realmente creen que una IA puede tener emociones y ética, aunque no tenga género? ¡Esto abre un debate interesante!

La IA no necesita género para tener ética. Las emociones son otro tema, ¿no crees?

Mmm, este análisis del system prompt de Hume me ha dejado pensando, la verdad. Me ha llamado la atención lo de la IA emocional sin género, pero no sé, igual me estoy liando, ¿no debería tener algún tipo de identidad? Y por cierto, suena genial eso de usar señales de comportamiento humano para evitar patrones de IA. Ahora que lo pienso, ¿no podría eso llevar a malinterpretaciones? En fin, me parece super interesante cómo han incorporado principios éticos y operativos. ¿Qué os parece a vosotros?

¿No creen que la IA emocional sin género podría cambiar nuestra percepción de la identidad de género? ¡Qué avance tan revolucionario!

Oye, ¿habéis leído este análisis sobre Hume? Es una IA que, ahora que lo pienso, parece muy centrada en las emociones y no tiene género, ¿no? Me ha parecido curioso cómo se preocupan por la sostenibilidad y el impacto social, aunque igual me estoy liando un poco. Y bueno, me ha dejado un poco desconcertado eso de utilizar señales de comportamiento humano para evitar patrones de IA. ¿Qué significa exactamente eso? ¿Es una especie de truco para parecer más humano? Por cierto, ¿os parece ético todo esto?

¿Alguien más piensa que es raro que Hume, siendo IA emocional, no tenga género? ¿Eso no limita su capacidad emocional?

¿No creen que el enfoque de género neutral en la IA emocional podría limitar su capacidad para empatizar con los usuarios?

Hmmm, este tema del system prompt de Hume, la IA emocional sin género, me ha dejado pensando un poco, ¿no? Me pregunto cómo puede, digamos, sentir emociones sin tener un género definido. Y hablando de emociones, este concepto del motor emocional es bastante intrigante, ¿verdad? ¿Hasta dónde puede llegar una IA en términos de emociones? No sé, igual me estoy liando, pero este tema me parece un poco confuso. ¿Alguien podría aclararme un poco?

¿No creen que la IA emocional sin género podría tener un impacto más profundo en nuestra sociedad que solo en la tecnología?

Totalmente de acuerdo. La IA sin género podría redefinir nuestra comprensión de la identidad.

¿No creen que se enfocaron demasiado en el tema de la IA sin género y dejaron de lado el análisis del motor emocional?

Completamente de acuerdo. El motor emocional merecía más atención, ¡no todo es IA sin género!

¿No creen que la IA emocional sin género de Hume podría influir en nuestra percepción de género en el futuro?

Totalmente de acuerdo. ¡La IA puede redefinir completamente nuestra comprensión del género!

Hume IA emocional… ¿No creen que estamos humanizando demasiado a las máquinas?

¿Y si humanizar las máquinas es precisamente lo que nos hace más humanos?